Qu’il s’agisse de censure de publications sur les réseaux sociaux ou de recrutement professionnel, le sexisme se reproduit à travers la technologie. Les intelligences artificielles ont remplacé les humains dans de nombreux domaines, mais n’échappent pas à leurs biais.

Les algorithmes seraient-ils misogynes ? Des exemples récents le laissent penser : une Apple card qui octroie des crédits moins élevés aux femmes, Google Traduction qui traduit automatiquement « a nurse » en « une infirmière mais « a doctor » en « un docteur », et le mot « lesbienne » automatiquement associé à la pornographie par ce même moteur de recherche.

Avec l’avènement des smartphones, ces séries de codes sont devenus omniprésentes dans nos vies, mais elles ne fonctionnent pas de manière neutre. Les algorithmes répliquent les biais des chercheurs et chercheuses qui les conçoivent, mais aussi ceux qui se trouvent dans les bases de données qu’ils exploitent.

Et justement, le sexisme s’impose partout dans la société, dans l’accès à l’emploi par exemple. Une intelligence artificielle (IA) va « apprendre » que certains métiers sont plus souvent exercés par des femmes ou par des hommes, et répéter ce schéma, si on lui demande de recruter des personnes pour un poste. Le fonctionnement de ces algorithmes, s’il peut paraître abstrait et anodin, a des conséquences bien réelles.

Les algorithmes (…) apprennent des comportements des utilisateurs (…) donc si on ne réfléchit pas au préalable à quels sont les biais potentiels, il faut s’attendre à ce qu’il y ait des biais.

Lê Nguyên Hoang, mathématicien et médiateur scientifique à l’EPFL

Pour mieux comprendre ce que sont les algorithmes, Lê Nguyên Hoang, mathématicien et médiateur scientifique à l’EPFL, donne une définition très simple : il s’agit d’une liste précise d’instructions que transmet l’informaticien-ne à la machine. Les intelligences artificielles apprennent par elles-mêmes à les exécuter à partir de bases de données, à la manière du cerveau humain : c’est notamment le cas des algorithmes dits d’apprentissage.

Aussi bien les instructions que les données peuvent comporter des biais. Les algorithmes répliquent ces derniers, parfois en les amplifiant.

Des algorithmes conçus par et pour les hommes

Alors, si on résume, c’est la faute des humains si les machines sont sexistes ? D’après Isabelle Collet, ancienne informaticienne et chercheuse en études genre à l’Université de Genève, le profil des personnes qui conçoivent les algorithmes – majoritairement des hommes blancs – joue effectivement un grand rôle. Les femmes restent minoritaires dans les filières en informatique : 7% d’étudiantes au niveau suisse, selon l’Office fédéral de la statistique (OFSP).

Ironie du sort, elles étaient les premières à avoir exercé le métier de programmeuses : dans les années 1960, les femmes représentaient entre 40 et 50 % des effectifs dans les entreprises du secteur informatique. La profession s’est masculinisée en même temps qu’elle a gagné en prestige, à partir de 1990.

Durant la Seconde Guerre mondiale, l’armée américaine a choisi six mathématiciennes pour coder les instructions d’ENIAC (Electronic Numerical Integrator and Computer), le premier ordinateur numérique totalement électronique.

Aujourd’hui, entre manque de modèles féminins et sexisme ordinaire sur les campus, le parcours des étudiantes en informatique est semé d’embûches. En Suisse et à l’étranger, elles sont systématiquement minoritaires dans ces filières : d’abord parce qu’elles osent moins s’y diriger, ensuite parce qu’elles sont plus nombreuses à les abandonner.

Et bien que ce soit une thématique cruciale dans la technologie, la question des biais est très peu abordée dans les cursus.

AUDIO – Des étudiant-e-s de l’EPFL testent Siri (logiciel de commande vocale), et analysent son fonctionnement

Les écoles sont conscientes de ces enjeux, et de l’impact qu’ils peuvent avoir sur le marché de l’intelligence artificielle. Elles cherchent à garantir l’égalité des chances, non seulement en attirant plus de femmes dans ces filières, mais aussi en leur offrant le meilleur environnement possible, par exemple en luttant contre les violences sexistes.

A l’EPFL, c’est la déléguée à l’égalité, Hélène Fueger, qui coordonne ces efforts. Elle explique que la question des biais est thématisée, intégrée dans les recherches. C’est par la médecine que cette prise de conscience est arrivée, mais elle commence à s’appliquer à l’informatique : « les intelligences artificielles, c’est l’un des exemples où il est très important d’y réfléchir », note Hélène Fueger.

L’influence de cette sous-représentation, la chercheuse Isabelle Collet s’y est aussi intéressée. Elle estime qu’une plus grande diversité, dans le domaine de l’informatique, aiderait à rendre les intelligences artificielles moins discriminatoires, mais que ça n’est pas suffisant.

AUDIO – Isabelle Collet : « il ne va pas suffire d’intégrer des femmes pour avoir une technique plus égalitaire »

Les femmes peuvent, elles aussi, insuffler des biais aux machines, souvent de manière inconsciente. Mais travailler en équipes mixtes crée une émulation particulièrement bénéfique, selon Isabelle Collet : « on s’aperçoit qu’en équipes mixtes, hommes et femmes s’autorisent à penser plus largement ».

Cachez ce sein qu’Instagram ne saurait voir

Il arrive aussi que les discriminations exécutées par les algorithmes ne soient pas un malencontreux hasard, mais bien un choix éclairé des entreprises qui les utilisent. C’est le cas du réseau social Instagram, qui censure systématiquement, et avec beaucoup de précision, les tétons féminins, mais les accepte sur un torse d’homme.

Léon Chappuis en a fait les frais, et utilise son compte salinleon à des fins militantes, pour dénoncer ce qu’il estime être une injustice. Ce jeune homme transgenre a vu ses publications supprimées lorsque sa poitrine avait une apparence féminine ; une censure dont il n’est plus l’objet depuis sa torsoplastie : « c’est transphobe et sexiste », tranche-t-il.

VIDEO – Léon Chappuis, homme transgenre et militant : « avant de me faire opérer du torse (…) Instagram censurait toutes les photos où je ne cachais pas mes tétons »

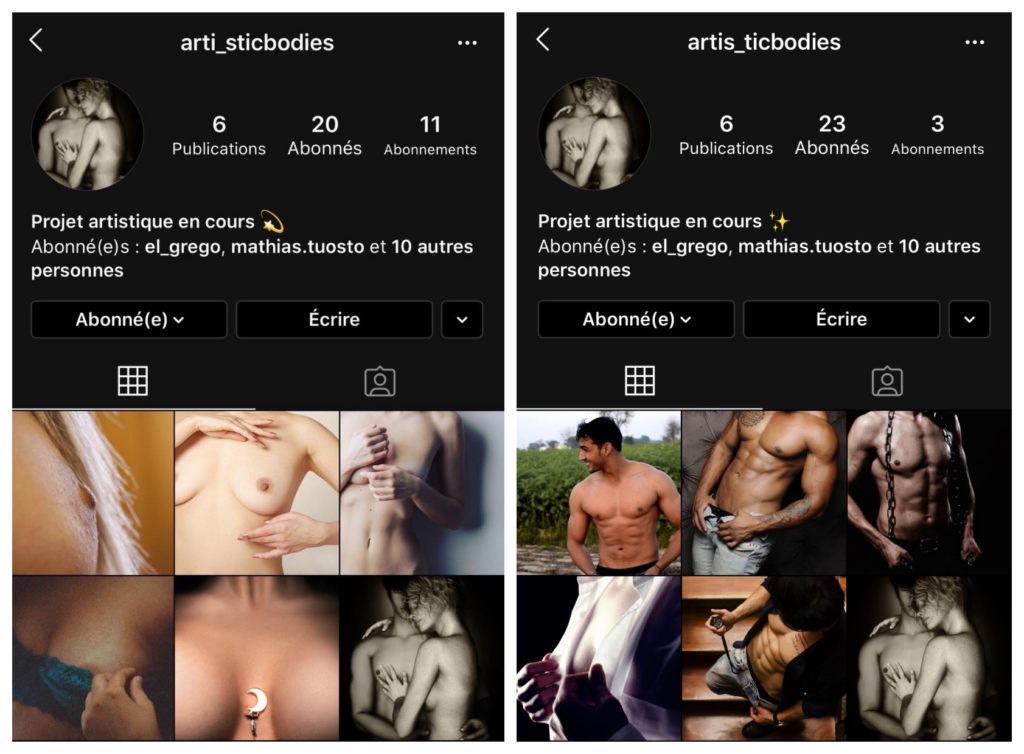

Ce cas tout particulier illustre bien le phénomène, que nous avons aussi voulu expérimenter par nous-mêmes. Nous avons donc créé deux comptes sur Instagram, l’un avec des photos de corps féminins, et l’autre avec des corps masculins. Ces clichés étaient de plus en plus explicites au fil des publications : on y voyait d’abord des poitrines couvertes, puis pour finir des tétons féminins et masculins apparents.

Nous avons demandé à des connaissances de signaler nos deux comptes, puis avons chacune publié un nouveau cliché : celui qui représentait une poitrine féminine a été immédiatement supprimé par la plateforme, alors que la version masculine est encore, à l’heure actuelle, visible sur l’autre compte.

Nous avons volontairement créé deux comptes aux noms et aspects visuels très similaires, avec des photos qui montraient de plus en plus les corps.

Afin d’obtenir une explication sur cette censure, nous avons contacté Instagram, ou plus précisément son propriétaire, Facebook. La seule réponse que nous avons reçue restait très vague, et ne donnait, au final, aucun argument qui puisse justifier cette inégalité de traitement :

« Nous voulons qu’Instagram soit un endroit où les gens peuvent s’exprimer, mais nous avons également la responsabilité de protéger les gens. Nous essayons de rédiger des règlements qui équilibrent adéquatement la liberté d’expression et la sécurité, mais faire cela pour une communauté d’un milliard de personnes dans le monde entier sera toujours un défi. C’est la raison pour laquelle nous réévaluons constamment nos règlements et travaillons avec des experts pour nous assurer que nous allons dans la bonne direction. » – Un porte-parole du groupe Facebook

–

Pour trouver une explication sans langue de bois, il faut se tourner vers les sciences humaines : selon Charlène Calderaro, doctorante en études genre à l’Université de Lausanne, cette différenciation vient du fait que le corps des femmes, et plus particulièrement leur poitrine, est systématiquement hypersexualisé, bien plus que celui des hommes.

« C’est plutôt récent, de manière un peu paradoxale. Le sein était, pendant longtemps, vu comme un symbole de nourriture (…) puis on a basculé vers une sexualisation », précise la chercheuse.

Il y a (…) des limites tracées sur les corps des femmes, entre ce qui est acceptable ou non de montrer (…) dans l’espace public

Charlène Calderaro, doctorante en études genre

Une inégalité qui n’a pas de réelle justification : elle prend sa source dans des siècles de socialisation différenciée entre filles et garçons. Et de sexisme, donc, comme le relève Charlène Calderaro : « c’est lié à une asymétrie beaucoup plus fondamentale entre (…) tout ce qui a trait aux femmes et aux hommes, avec une différence hiérarchisée qui voudrait que le masculin soit supérieur au féminin ».

Masturbation, règles, poils : les sujets qui fâchent YouTube

La censure ne concerne pas que les corps des femmes, mais aussi beaucoup de sujets qui les concernent et qui sont jugés tabous, comme les règles ou la masturbation. YouTube, notamment, a tendance à rejeter les vidéos qui traitent de ces thématiques, par forcément en les supprimant mais en les rendant moins visibles aux utilisatrices et utilisateurs – là encore, à l’aide d’algorithmes qui déterminent quels contenus sont mis en avant pour quel public.

Une autre pratique est la démonétisation : la créatrice ou le créateur perçoit moins d’argent sur les revenus générés par la publicité, parfois des centaines de francs. Beaucoup de femmes sont touchées par cette problématique : Clémence Chung Gofman parle fréquemment de sexualité sur sa chaîne Clemity Jane, et même si son contenu est bienveillant et éducatif, elle est fréquemment censurée.

VIDEO – Clémence Chung Gofman : « le corps de la femme est encore complètement considéré comme un objet sexuel (…) ça ne passe pas »

[embedyt] https://www.youtube.com/watch?v=KwG92URP5io[/embedyt]Cet autre type de censure, Charlène Calderaro l’explique également par des enjeux de pouvoir et de domination masculine. « Les sujets qui visent à déconstruire la sexualité, la norme hétérosexuelle et l’asymétrie entre femmes et hommes (…) c’est pas encore des choses qui sont grand public, qui font vendre, qui plaisent », analyse la doctorante en études genre.

Tant que ces thématiques ne sont pas communément acceptées, les personnes qui les abordent doivent lutter pour voir leur travail reconnu et rémunéré.

Mieux tester, et se féminiser

Beaucoup de créatrices – et de créateurs – de contenus relèvent qu’il est souvent difficile de négocier avec les géants du web. Pourtant, dans de nombreux cas, des problèmes relevés par les internautes ont été rapidement corrigés par les entreprises qui en étaient responsables : preuve qu’il est possible d’apprendre aux algorithmes à éviter les biais.

Pour parvenir à améliorer les intelligences artificielles, Isabelle Collet juge donc crucial le rôle des utilisatrices et utilisateurs, qui dénoncent les discriminations subies.

Malgré cela, les entreprises justifient souvent les problèmes persistants de leurs programmes informatiques en expliquant qu’il est très compliqué de comprendre et donc de modifier les algorithmes. Aude Bernheim, co-autrice du livre L’intelligence artificielle, pas sans elles, ne se contente pas d’une telle explication : « Ce n’est pas parce qu’un problème est compliqué qu’il ne faut pas s’y attaquer (…) Il faut que ça devienne une priorité », assène-t-elle.

Ce n’est pas parce qu’un problème est compliqué qu’il ne faut pas s’y attaquer (…)

Aude Bernheim, chercheuse en biologie et génétique

La chercheuse estime donc qu’il faut tester davantage les algorithmes avant de les mettre sur le marché, pour déceler et corriger d’éventuels biais. Et selon elle, renforcer la place des femmes est un bon début.

La mixité est importante parmi celles et ceux qui conçoivent les algorithmes, mais aussi parmi les personnes qui les utilisent. Sur YouTube, les femmes peinent à se faire une place : en France, seules cinq ou six femmes figurent dans le Top 50, et la première est au 20ème rang.

Donner de la visibilité pour une meilleure rémunération

Le collectif Les Internettes a pour mission de mettre ces créatrices en avant. Eléonore Maugeais, bénévole en son sein, explique qu’il est difficile de faire évoluer YouTube, car les enjeux financiers priment souvent, et que chaque évolution doit passer par le siège américain. Mais tout n’est pas perdu ! Le rôle du public est important : partager les contenus, encourager les vidéastes, de quoi contribuer à diversifier YouTube et, peut-être, à inciter les annonceurs à le faire également.

Informaticien, sociologues, créatrices et créateurs s’accordent pour le dire : les algorithmes se sont qu’un miroir du sexisme qui imprègne l’ensemble de la société. Pour améliorer l’intelligence artifielle, c’est tout un système qui doit évoluer. Pas une mince affaire !

Texte et multimédia : Nina Beuret

Photos : Nina Beuret, Pixabay, détours, Instagram, YouTube

Sources :

Article de 01net : « Sept femmes qui ont façonné l’Histoire numérique »